30 millions d’utilisateurs actifs par mois, 159 pays couverts, et un écosystème qui ne cesse de s’élargir. Claude AI n’est plus simplement « un autre chatbot ». En février 2026, l’assistant d’Anthropic s’est transformé en véritable plateforme de travail pour les entreprises, avec des agents autonomes, des connecteurs métier et des capacités de raisonnement qui bousculent les habitudes. Ce guide vous donne les clés pour comprendre l’ensemble de l’écosystème Claude AI, choisir le bon modèle, évaluer les coûts et préparer une adoption structurée dans votre organisation.

Claude AI, c’est quoi exactement ?

Claude AI est une famille de grands modèles de langage développée par Anthropic, une entreprise fondée en 2021 par Dario et Daniela Amodei, anciens chercheurs d’OpenAI. Là où la plupart des gens pensent « chatbot », la réalité est plus large. Claude, c’est trois choses à la fois : une interface de chat grand public (claude.ai), une plateforme développeur complète (API, SDK, Claude Code), et des déploiements cloud entreprise sur Google Vertex AI, AWS Bedrock et Microsoft Foundry.

Anthropic et la philosophie Constitutional AI

Ce qui différencie fondamentalement Anthropic de ses concurrents, c’est son approche de la sécurité. L’entreprise a développé ce qu’elle appelle la Constitutional AI : au lieu de s’appuyer uniquement sur des retours humains pour corriger le modèle, Claude est entraîné à suivre un ensemble de principes explicites, une sorte de « constitution numérique ». Concrètement, le modèle s’autocritique et ajuste ses réponses en fonction de ces principes avant même qu’un humain n’intervienne.

Pour une entreprise, ça se traduit par des réponses plus prévisibles, moins de surprises, et un temps de relecture réduit. Anthropic complète cette approche par sa Responsible Scaling Policy (RSP), qui impose des évaluations de sécurité obligatoires avant chaque déploiement de nouveau modèle. Côté certifications, on retrouve SOC 2 Type II, ISO 27001, ISO/IEC 42001 et une offre compatible HIPAA avec BAA disponible.

Ce qui distingue Claude de ChatGPT et Gemini

La question revient systématiquement. Et la réponse honnête, c’est que chaque outil a ses forces. Claude excelle sur les textes longs, l’analyse documentaire, la cohérence du raisonnement sur plusieurs échanges et la rigueur factuelle. ChatGPT reste souvent plus polyvalent pour la créativité rapide et dispose d’un écosystème de plugins plus mature. Gemini tire son épingle du jeu grâce à son intégration native avec Google Workspace.

Mais la vraie différence se joue sur un point que les comparatifs rapides oublient souvent: la fenêtre de contexte. Claude Opus 4.6 et Sonnet 4.6 supportent jusqu’à 1 million de tokens en bêta, soit l’équivalent de plusieurs milliers de pages. Pour quiconque travaille avec des documents volumineux (contrats, rapports, code source), cette capacité change la donne.

Les modèles Claude: lequel choisir pour quel usage ?

Anthropic propose actuellement trois familles de modèles actifs: Opus, Sonnet et Haiku. Chacune répond à un besoin différent, et le choix du bon modèle a un impact direct sur la qualité des résultats, la vitesse de réponse et la facture à la fin du mois.

Opus 4.6: le raisonnement de pointe

Sorti le 5 février 2026, Claude Opus 4.6 est le modèle le plus puissant d’Anthropic. Il intègre l’adaptive thinking, une capacité qui lui permet de doser automatiquement son effort de réflexion en fonction de la complexité du problème. Pour une question simple, il répond instantanément. Pour l’analyse d’un document de 100 pages, il déclenche un raisonnement approfondi.

Ses résultats sur les benchmarks parlent d’eux-mêmes : 80,8 % sur SWE-bench Verified (codage), 90,2 % sur BigLaw Bench (juridique), et un score de 1633 Elo sur GDPval pour le travail de connaissance. C’est le modèle à utiliser pour les tâches complexes : analyse juridique, cybersécurité, recherche, codage multi-fichiers ou agents autonomes longue durée.

Sonnet 4.6 : le meilleur rapport qualité-prix

Lancé le 17 février 2026, Sonnet 4.6 offre des performances très proches d’Opus pour un coût nettement inférieur. Avec 79,6 % sur SWE-bench et 72,5 % sur OSWorld (utilisation autonome d’ordinateur), il convient à la grande majorité des usages professionnels quotidiens : rédaction, analyse de données, workflows entreprise, computer use.

C’est d’ailleurs le modèle par défaut sur claude.ai, y compris pour les utilisateurs du plan gratuit. Pour la plupart des professionnels, Sonnet 4.6 sera le bon choix.

Haiku 4.5: la vitesse avant tout

Haiku est le modèle léger de la gamme. Il sacrifie une partie du raisonnement complexe au profit de la rapidité et du coût réduit. C’est le modèle idéal pour les chatbots de support client, la modération de contenu, le traitement de données en masse ou les architectures multi-agents où plusieurs instances tournent en parallèle.

Tableau comparatif: modèles, forces et tarifs

| Modèle | Cas d’usage principal | Contexte | Coût API (input/output par MTok) |

|---|---|---|---|

| Opus 4.6 | Codage complexe, agents, juridique, recherche | 200K (1M en bêta) | $5 / $25 |

| Sonnet 4.6 | Usage quotidien, coding, workflows, computer use | 200K (1M en bêta) | $3 / $15 |

| Haiku 4.5 | Chatbots, modération, sous-agents, données en masse | 200K | $1 / $5 |

Les tarifs sont exprimés en dollars par million de tokens. Le prompt caching permet de réduire les coûts d’input jusqu’à 90 %.

L’écosystème Claude au-delà du chat

Réduire Claude à une simple fenêtre de conversation, c’est passer à côté de l’essentiel. L’écosystème d’Anthropic en 2026 est constitué d’un ensemble d’outils interconnectés qui transforment Claude en véritable environnement de travail.

Projects, Artifacts et Memory : structurer son travail

Les Projects permettent de créer des espaces de travail dédiés à un sujet. Vous y déposez vos fichiers (charte éditoriale, briefs, données), définissez des instructions personnalisées, et Claude utilise ce contexte dans chaque conversation du projet. Plus besoin de tout réexpliquer à chaque échange.

Les Artifacts sont des blocs de contenu autonomes que Claude génère à côté de la conversation : documents, code, tableaux, visualisations interactives. Ils s’affichent dans un panneau séparé et peuvent être copiés, modifiés ou partagés.

La Memory, disponible sur les plans Pro et supérieurs, permet à Claude de retenir le contexte entre les conversations. Vous pouvez la consulter, la modifier et l’effacer à tout moment. C’est ce qui permet de construire une relation de travail continue plutôt que de repartir de zéro à chaque session.

Cowork: le workspace agentique

Cowork est probablement la fonctionnalité la plus sous-estimée de Claude en 2026. Disponible sur Desktop (macOS et Windows), Cowork donne à Claude un accès direct à vos fichiers locaux. Il peut lire, créer et éditer des documents, exécuter des tâches multi-étapes, le tout de manière autonome.

En pratique, vous pouvez lui demander de réorganiser un dossier de rapports, de générer des synthèses à partir de plusieurs fichiers, ou de préparer un livrable complet. Claude planifie les étapes, les exécute, et vous livre le résultat. Ce n’est plus de l’assistance, c’est de la délégation.

Claude Code: l’IA au service des développeurs

Claude Code est l’outil de codage agentique d’Anthropic. Il fonctionne dans le terminal, dans les IDE (VS Code, JetBrains), sur Desktop, sur le web et même dans Slack. Il comprend votre codebase, édite des fichiers, lance des commandes, et peut gérer des pull requests de bout en bout.

La nouveauté de février 2026 : les Agent Teams, où plusieurs agents travaillent en parallèle et se coordonnent sur un même projet. Pour les équipes de développement, c’est un gain de productivité considérable sur les revues de code, les migrations et le refactoring.

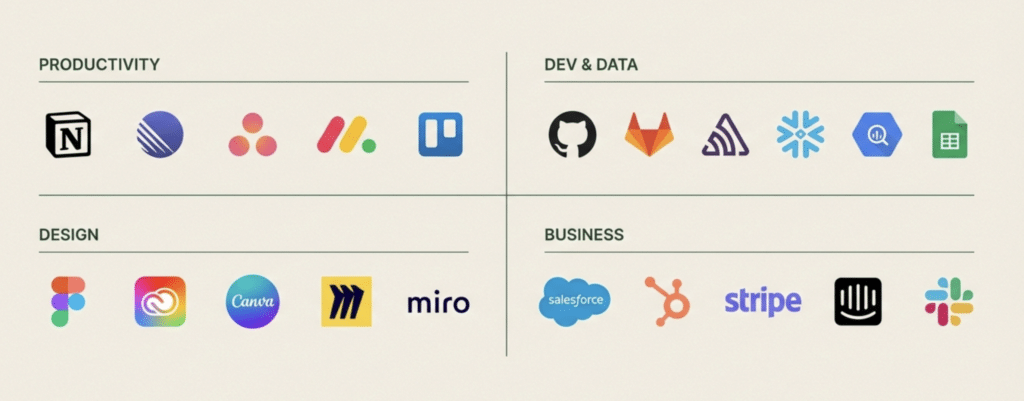

MCP et Connectors : connecter Claude à vos outils métier

Le Model Context Protocol (MCP) est un standard ouvert créé par Anthropic pour connecter les modèles IA aux outils et données externes. Pensez-y comme un « USB universel » pour l’IA : au lieu de créer une intégration spécifique pour chaque outil, MCP offre une interface standardisée.

Depuis janvier 2026, Claude peut se connecter directement à Slack, Canva, Figma, Box, Asana et d’autres outils via les Connectors. Ce ne sont pas des intégrations superficielles. Claude peut lire des informations, mettre à jour des statuts, créer des entrées. Il exécute réellement des actions dans vos outils.

Le MCP a été adopté bien au-delà d’Anthropic : OpenAI et Google DeepMind l’utilisent également, et le protocole a été confié à la Linux Foundation fin 2025.

Plans et tarifs : du gratuit à l’Enterprise

La question du prix est souvent le premier frein. Voici ce qu’il faut retenir.

Comparatif des plans (Free, Pro, Max, Team, Enterprise)

| Plan | Prix | Modèles accessibles | Fonctionnalités clés |

|---|---|---|---|

| Free | 0 CHF | Sonnet 4.6, Haiku | Chat, web search, Artifacts, code execution |

| Pro | ~18 CHF/mois* | Tous (incl. Opus 4.6) | Claude Code, Cowork, Projects illimités, Research, Memory |

| Max 5× | ~90 CHF/mois* | Tous | 5× la capacité Pro, priorité maximale, Claude Code complet |

| Max 20× | ~180 CHF/mois* | Tous | 20× Pro, latence quasi-nulle, early access features |

| Team | Dès ~23 CHF/mois/siège* | Tous | SSO, admin, billing centralisé, Slack/M365 intégration |

| Enterprise | Sur devis | Tous | Contexte 500K+, SCIM, audit logs, HIPAA, rétention custom |

*Tarifs indicatifs basés sur la conversion USD/CHF de février 2026. La facturation Anthropic est en USD uniquement.

Pour la plupart des professionnels qui veulent aller au-delà du simple chat, le plan Pro à $20/mois constitue le point d’entrée logique. Il débloque Opus 4.6, Cowork, la Memory et les Projects illimités. Les équipes qui ont besoin d’une gouvernance centralisée opteront pour le plan Team.

Tarification API pour les usages avancés

L’API Claude fonctionne en paiement à l’usage (pay-per-token). Pour donner un ordre de grandeur concret: un chatbot de support traitant 50 000 tickets par mois avec Sonnet en mode batch revient à environ $2 600/mois. Un workflow d’agent RAG avec Opus 4.6 et prompt caching peut descendre sous les $100/mois pour 500 requêtes quotidiennes.

Le système de tiers (Tier 1 à 4) détermine vos limites de débit et de dépenses mensuelles. Un dépôt cumulé de $400 donne accès au Tier 4 avec 4 000 requêtes par minute sur Sonnet et la fenêtre 1M tokens.

Sécurité, conformité et données: ce que les entreprises doivent savoir

C’est souvent la section qui décide de l’adoption ou du rejet de Claude dans une organisation. Prenons les points un par un.

Politique de données et rétention

Par défaut, Anthropic ne forme pas ses modèles sur les données client. C’est un opt-in uniquement. La rétention par défaut est de 30 jours pour le chat et 7 jours pour l’API. Les entreprises peuvent activer le Zero Data Retention (ZDR) pour supprimer toute conservation.

Pour les organisations suisses soucieuses de la conformité GDPR, les déploiements via Google Vertex AI (région Frankfurt, europe-west3) ou AWS Bedrock (eu-central-1 via cross-region inference) permettent de maintenir les données en Europe.

Certifications et conformité

Anthropic détient les certifications SOC 2 Type I et II, ISO 27001:2022 et ISO/IEC 42001:2023. Une offre HIPAA-ready avec BAA est disponible pour les secteurs de la santé. L’entreprise publie des « system cards » détaillées pour chaque modèle, avec les évaluations de capacité et de sécurité, dans son Transparency Hub.

Déploiements cloud: Vertex AI, AWS Bedrock, Microsoft Foundry

Les entreprises qui ne souhaitent pas passer par l’API directe d’Anthropic ont trois options de déploiement managé. Google Vertex AI et AWS Bedrock proposent tous les modèles actuels (Opus 4.6, Sonnet 4.6, Haiku 4.5) avec un premium de 10 % sur les endpoints régionaux. Microsoft Foundry est annoncé mais les détails d’implémentation restent limités.

Le choix dépend de votre infrastructure existante : Vertex AI pour les entreprises GCP-native, Bedrock pour les environnements AWS, l’API directe d’Anthropic pour les startups et les projets agiles qui veulent les dernières features en premier.

Comment adopter Claude AI dans votre organisation

Avoir accès à l’outil ne suffit pas. La différence entre une expérimentation qui tourne court et une adoption réussie tient en un mot: la méthode.

Les cas d’usage les plus porteurs par métier

En marketing et communication, Claude excelle dans la génération de contenu multi-canal (blog, social, email), l’analyse concurrentielle automatisée et la veille sectorielle. Les équipes rapportent régulièrement une réduction de 70 % du temps de rédaction, à condition de structurer correctement les briefs.

En support client, un chatbot Claude sur Sonnet 4.6 avec accès au CRM et au système de ticketing peut résoudre plus de 70 % des demandes de niveau 1 de manière autonome. Le coût d’un tel déploiement pour 50 000 tickets mensuels reste sous les $3 000.

Pour les équipes juridiques, la combinaison d’Opus 4.6 et de la fenêtre 1M tokens permet d’analyser des contrats entiers, d’extraire des clauses à risque et de préparer des synthèses, avec une précision d’extraction supérieure à 95 %. Bien entendu, aucune décision juridique ne devrait être prise sans validation par un avocat.

En développement logiciel, Claude Code avec Agent Teams transforme les revues de code, les migrations de codebase et le refactoring. Les résultats de 80,8 % sur SWE-bench Verified ne sont pas qu’un chiffre marketing: ils se traduisent par des suggestions pertinentes et des corrections automatisées qui tiennent la route en production.

Monter en compétence: pourquoi la formation fait la différence

Un constat revient dans toutes les organisations qui adoptent l’IA: l’outil seul ne produit rien. C’est la capacité des équipes à formuler les bons prompts, à choisir le bon modèle pour chaque tâche, et à intégrer Claude dans leurs workflows existants qui détermine le retour sur investissement.

Les erreurs les plus fréquentes? Utiliser Opus pour des tâches simples (facture inutilement élevée), ne pas exploiter les Projects ni la Memory (perte de contexte systématique), ou encore publier du contenu généré sans relecture ni enrichissement humain (risque E-E-A-T pour le SEO).

Une formation structurée permet d’éviter ces écueils et d’atteindre un niveau d’autonomie opérationnel en quelques semaines plutôt qu’en plusieurs mois de tâtonnements.

FAQ: Claude AI en questions

Claude AI est-il disponible en Suisse?

Oui. La Suisse fait partie des 159 pays où Claude est accessible. Tous les plans sont disponibles, du gratuit à l’Enterprise. La facturation se fait en USD uniquement. Pour les entreprises soumises au GDPR, les déploiements via Vertex AI (Frankfurt) ou AWS Bedrock permettent une résidence des données en Europe.

Claude AI est-il gratuit?

Le plan Free donne accès à Sonnet 4.6 et Haiku avec des limites de messages. Pour un usage professionnel régulier, le plan Pro à $20/mois est recommandé. Il débloque tous les modèles, Cowork, la Memory et les Projects illimités.

Quelle est la différence entre Claude et ChatGPT?

Claude se distingue par sa fenêtre de contexte massive (jusqu’à 1M tokens), sa cohérence sur les échanges longs, et son approche Constitutional AI orientée sécurité. ChatGPT offre un écosystème de plugins plus large et des capacités multimodales plus avancées (génération d’images, vidéo). Le meilleur choix dépend de votre cas d’usage.

Anthropic utilise-t-il mes données pour entraîner ses modèles?

Non, pas par défaut. L’entraînement sur les données client est en opt-in uniquement. La rétention par défaut est de 30 jours (chat) et 7 jours (API). Le Zero Data Retention (ZDR) est disponible pour les entreprises qui le nécessitent.

Quel modèle Claude choisir pour commencer?

Sonnet 4.6 couvre 80 % des usages professionnels avec le meilleur rapport performance/coût. Réservez Opus 4.6 pour les tâches complexes (juridique, codage avancé, agents autonomes) et Haiku 4.5 pour les traitements en volume nécessitant rapidité et faible coût.

Comment se former à Claude AI en Suisse romande?

Des formations professionnelles certifiantes existent pour maîtriser Claude AI et l’intégrer dans vos processus métier. OnFuture propose des parcours adaptés aux professionnels et aux entreprises, avec un accompagnement structuré qui va de la prise en main à l’utilisation avancée.